Apple opustil zamisel o skeniranju naprav v lovu za otroško pornografijo

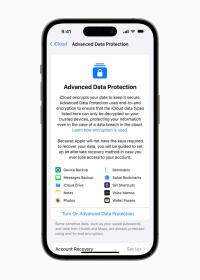

V Cupertinu so lansko poletje razburili z najavo orodja NeuralHash, s katerim so se želeli spoprijeti s problematiko hranjenja šifriranih vsebin s spolnimi zlorabami otrok na iphonih. Po tej zamisli bi se iz slik napravilo zgoščene vrednosti (hashe) in se nato te primerjalo z bazami podatkov poznanih vsebin CSAM (child sexual abuse material). Toda analitiki so hitro ugotovili, da je predstavljena Applova rešitev pomanjkljiva in proizvaja lažne alarme, pomenila pa je tudi splošno nevarnost za zasebnost uporabnikov, zato je bilo lansiranje prestavljeno na nedoločen kasnejši datum. Sedaj je jasno, da je podjetje upanje na izpopolnitev tega orodja opustilo. Namesto...

![Steve Jobs med popolno in objektivno primerjavo treh servisov za oblačno shranjevanje in streamanje glasbe. V ZDA je ti. 'primerjalno oglaševanje' sicer bolj pogosto in manj regulirano kot v EU [4]](https://static.slo-tech.com/51888sm.jpg)