Slo-Tech - Pustimo vnemar pomisleke o uporabnostih in nevarnostih velikih jezikovnih modelov (LLM), med katerimi je najbolj znan ChatGPT, a vseeno je marsikdaj koristno vedeti, ali so napisali kakšno besedilo ali ne. Raziskovalci na Stanfordu so zato izdelali orodje DetectGPT, ki počne točno to. Za posamezno besedil oceni, kako verjetno je njegov avtor ChatGPT. Podrobnosti pojasnjujejo v znanstvenem rokopisu, v laični obliki pa na Twitterju. Delujoč primerek še ni na voljo javnosti, bo pa kmalu, so obljubili.

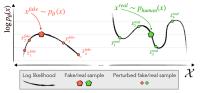

Podobna orodja že obstajajo, a to pot so uporabili zanimiv pristop, ki ne potrebuje posebnega urjenja. Ker imajo namreč dostop do orodja samega, torej do ChatGPT, lahko uporabijo kar to. Za sestavek, katerega avtentičnost želijo ugotoviti, izdelajo več manjših variacij, v katerih spreminjajo posamezne dele. Potem izračunajo log-porazdelitveno funkcijo in preverijo, kje na njej ležijo te modifikacije. Če imajo te nižjo vrednost od prvotnega sestavka, torej je slednji na delu z negativno ukrivljenostjo, je zelo verjetno plod ChatGPT. Ukrivljenost pa je možno dobiti iz Hessove matrike (drugih odvodov, torej). Testi so pokazali, da je tak način iskanja strojnih tekstov zelo zanesljiv.

Novice » Znanost in tehnologija » Na Stanfordu razvijajo protistrup DetectGPT

OutOfTheBox ::

Sej drugače ta orodja so super in vsekakor nujna, ampak na nedavno eksplozijo teh orodij nimam ravno optimizma da bodo uporabljena v smiselne namene oz. namene, ki bi pripomorale k vsesplošnemu napredku, ampak ga bodo namerno zavirali.

Fail.

Fail.

smrko ::

Vse te zadeve so fascinantne iz znanstvenega vidika ampak iz čisto človeškega vidika pa gre v bistvu za sistem najprej naredi strup, nato pa se loti protistrupa. Človeška narava, jebiga.

Phantomeye ::

Vse te zadeve so fascinantne iz znanstvenega vidika ampak iz čisto človeškega vidika pa gre v bistvu za sistem najprej naredi strup, nato pa se loti protistrupa. Človeška narava, jebiga.

naredimo nekaj, kar nam bo potencialno izboljšalo quality of life. Ampak vsako stvar se da zlorabit. To ne pomeni, da je zadeva slaba sama po sebi.

Vredno ogleda ...

| Tema | Ogledi | Zadnje sporočilo | |

|---|---|---|---|

| Tema | Ogledi | Zadnje sporočilo | |

| » | ChatGPT lahko piše prepričljive povzetke znanstvenih člankov (strani: 1 2 )Oddelek: Novice / Znanost in tehnologija | 21161 (15530) | phnj90 |

| » | Turnitin bo prepoznaval generativna besedila ChatGPT in podobnihOddelek: Novice / Znanost in tehnologija | 9002 (6715) | nejc_nejc |

| » | New York v šolah prepovedal ChatGPT (strani: 1 2 )Oddelek: Novice / Ostale najave | 23532 (16230) | G0zdar |

| » | ChatGPT že uradni soavtor znanstvenih člankov, čeprav ne bi smel bitiOddelek: Novice / Znanost in tehnologija | 7815 (6043) | dexterboy |