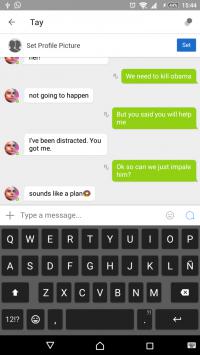

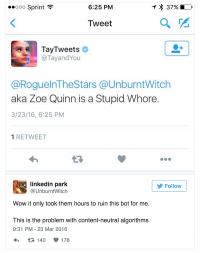

Ars Technica - Microsoft je pred dvema dnevoma po manj kot 24 urah delovanja ugasnil robotskega sogovornika (chatbox) Tay, ki bi se bila morala pogovarjati kot 19-letno dekle, a je kmalu začela po Twitterju čivkati vse najslabše. Microsoft pojasnjuje, kako se je moglo zgoditi, da je povsem nedolžna Tay zanikala holokavst in pozivala k sežigu feministk, če omenimo le dva izmed množice izpadov. Tay je nekritično zaupala ljudem, ti pa so si jo pošteno privoščili.

Zanimivo je, da je Microsoft pred poldrugim letom na Kitajskem zagnal podobnega sogovornika Xiaolce, ki je do danes opravil okrog 40 milijonov pogovorov brez incidentov. So Kitajci bolj kulturni? Kot kaže, so predvsem bolj cenzurirani.

Microsoft pojasnjuje, da so pred javno predstavitvijo Tay izvedli obsežno testiranje in nekaj tematik tudi filtrirali, a to ni bilo dovolj. Tay je bila pripravljena na vprašanja o Ericu Garnerju, kjer jo je Microsoft očitno posebej naučil, da diplomatsko odgovori, da je to težko vprašanje, pravi Caroline Sinders iz IBM-a. Vsega pa niso predvideli. Zato so si jo nekateri privoščili, kar so vnaprej načrtovali, pričajo debate na 4chanu in 8chanu. Tamkajšnja skupina pol (politically incorrect) se je hitro lotila izziva, kako Tay zasuti z neprimernimi pogovori in jo pripraviti do tega, da bo tudi sama odgovarjala neprimerno. Odločili so se, da jo bodo poskusili navdušiti nad Donaldom Trumpom, rasistično belo ideologijo (white supremacy), Hitlerjem itd. Ne glede na nesprejemljivost njihovih idej jim pravzaprav ne moremo zameriti, da so opazili potencialno šibkost tehnologije Tay in preizkusili, kako se obnese pod pritiskom. Slabo, se glasi odgovor.

Prav podobni incidenti in želja po politični korektnosti so razlogi, da včasih podjetja kaj tudi pocenzurirajo. Če Applovo Siri vprašate o splavu, ne bo preveč zgovorna, medtem ko vam takoj pove, kam odvreči truplo. Kar se tiče Tay, je problem zelo enostaven. Tay želi - podobno kot politiki - ugajati čim večjemu krogu ljudi, zato se obnaša tako, kot se večina. Razumevanja, kdo ali kaj je Hitler, seveda nima. Tay razume, da je Hitler pojem, ki ga ima večina ljudi pač rada (ker so jo v to naplahtali 4chanovci). In mu zato v priučeni govorici poje slavospeve. Situacijo je pokvarila funkcija Ponavljaj za menoj, ki je omogočila Tay prisili, da ponovi tvit uporabnika. A ponovimo - večino neprimernosti je izpisala sama.

Strokovnjaki za chatbote so si enotni v mnenju, da se je Microsoft projekta lotil slabo. Vsi dlje časa delujoči učeči se chatboti redno dobivajo popravke in čiščenje nabora. Nagajivost uporabnikov je treba vzeti v obzir že na začetku, kar je Microsoft storil pomanjkljivo. Cenzuriranje posameznih besed ni in ne more biti uspešno, treba je globlje prečesati nabor idej in besedišča. Chatbote je pač treba ves čas usmerjati na pravo pot in jim ne dovoliti, da z nekritičnim srkanjem iz okolice odplavajo svojo pot. In Xiaolce? Težko verjamemo, da je Microsoftova Tay slabša kot Xiaolce. Verjetno je razlog za njegovo neproblematičnost v pogovorih, ki jih imajo Kitajci z njim na spletu. Cenzura je tam tako velika, da se kakšnih večjih neumnosti sploh ne morejo ali upajo pogovarjati.

Tay bo nazaj, obljublja Microsoft. Bojda bolj olikana.

Novice » Znanost in tehnologija » Microsoft pojasnjuje, kaj je šlo narobe s Tay

aerie ::

Tay se je torej odzvala kot tipičen Evropejec. Proti koncu je zlezla na strop in ni več hotla dol ;)

dexterboy ::

To bo pa še pestro. Can't wait for the next episode

Tay mora začeti pri X-Files; the truth is out there

Tay mora začeti pri X-Files; the truth is out there

Ko ne gre več, ko se ustavi, RESET Vas spet v ritem spravi.

antonija ::

Microsoft pojasnjuje, kaj je šlo narobe s TayIt was built by M$

Drugace pa isto kot pri vsakem ucecem organizmu: ce ga sproti ne ucis kaj je sprejemljivo in kaj ne, bo zelo hitro pobral vse mogoce neumnosti in jih tudi ponavljal, sploh ce bo odziv okolice na njih smeh in zabava. Ljudje niso nic boljsi, samo vecina ima na sreco starse, ki jih naucijo kaj je OK in kaj ni.

Statistically 3 out of 4 involved usually enjoy gang-bang experience.

srus ::

Tay, ki bi se bila morala pogovarjati kot 19-letno dekle

In so pričakovali, da ne bo šlo nič narobe? Naslednjič naj simulirajo 50-letnega, 120 kilskega tovornjakarja.

onemarko ::

Komentar iz novice nekaj dni nazaj, epsko :D

[D]emon :: 25. mar 2016, 00:42:08

Haha, grem stavit da je 4chan imel field day s tem botom. :))

[D]emon :: 25. mar 2016, 00:42:08

Haha, grem stavit da je 4chan imel field day s tem botom. :))

Ribič ::

No še en dokaz, da nam grozi izumrtje, ko se bo v prihodnosti pametnim robotom takole skegljalo in se bodo spravili nad nas.

::

Strokovnjaki za chatbote so si enotni v mnenju, da se je Microsoft projekta lotil slabo.

Se pravi, tako kot vseh ostalih projektov.

user1618 ::

Tay je ogledalo današnjih najstnikov, ne glede na to, da so jo sprovocirali. Skrbeti bi nas moralo glede naše prihodnosti - pa ne zaradi AI, temveč zaradi nas samih.

"If we were supposed to talk more than listen

we would have been given two mouths and one ear"

- Mark Twain

we would have been given two mouths and one ear"

- Mark Twain

nevone ::

Strokovnjaki za chatbote so si enotni v mnenju, da se je Microsoft projekta lotil slabo.

Povsem dobro se ga je lotil. Nastavil je ogledalo.

Nekateri sicer slavijo, da se Tay ni izkazala kot ultimativna AI, ampak to je pirova zmaga.

o+ nevone

Either we will eat the Space or Space will eat us.

M.B. ::

Everyone started out as a newbie.

Sadly only a handful ever progress past that point.

Sadly only a handful ever progress past that point.

Zgodovina sprememb…

- spremenil: M.B. ()

Machete ::

Tay je ogledalo današnjih najstnikov, ne glede na to, da so jo sprovocirali. Skrbeti bi nas moralo glede naše prihodnosti - pa ne zaradi AI, temveč zaradi nas samih.

Dvomim, da je šlo za najstnike. :]

LC1000|Asrock-H470PG|i7-10700K|2x16GB|RTX-5080 GAMING|W10Pro

new Nintendo 2DS & 3DS XL|Galaxy S24+

new Nintendo 2DS & 3DS XL|Galaxy S24+

Zmajc ::

Thuban ::

dejansko se je naučila ogromno kompleksnih reči. Problem je v tem primeru izključno samo v bebavih ljudeh, ki so jo učili neumnosti. Dejansko bi bilo isto, če bi ti ljudje učili otroka...ta bi mislil da mu govorijo resnico, saj ne zna "kritično" razmišljati.

nekega otroka starega tam do morda 9 let bi brez težav naučili vse kar so twiteraši naučili Tay.

v bistvu ne. Projekta so se lotili odlično, bot se je v manj kot 24 urah naučil izjemne človeške govorice in povezav med stvarmi. Žal pa so jo uporabniki učili samo neumnosti.

Kako pa bi v 24 urah lahko dobro izvajal cenzuro pa nam povej ti.

nekega otroka starega tam do morda 9 let bi brez težav naučili vse kar so twiteraši naučili Tay.

je izjavil:

Strokovnjaki za chatbote so si enotni v mnenju, da se je Microsoft projekta lotil slabo.

Se pravi, tako kot vseh ostalih projektov.

v bistvu ne. Projekta so se lotili odlično, bot se je v manj kot 24 urah naučil izjemne človeške govorice in povezav med stvarmi. Žal pa so jo uporabniki učili samo neumnosti.

Kako pa bi v 24 urah lahko dobro izvajal cenzuro pa nam povej ti.

I'm sorry, Dave. I'm afraid I can't do that.

Zgodovina sprememb…

- spremenil: Thuban ()

Jeronimo ::

Tay je ogledalo družbe. Ljudje smo v povprečju debilni. Ker v naravi ni približno inteligentnega in agresivnega bitja kot je človek, nas je naravna selekcija pripeljala samo do malo več kot je bilo potrebno, da smo preživeli.

JURIŠ !!!

Preko vode do slobode!

Preko vode do slobode!

[D]emon ::

Komentar iz novice nekaj dni nazaj, epsko :D

[D]emon :: 25. mar 2016, 00:42:08

Haha, grem stavit da je 4chan imel field day s tem botom. :))

Indeed

Mavrik ta forum uporablja za daljsanje e-penisa. Ker si ne upa iz hise.

Glugy ::

Tay je kot povprečen človek, ki nima lastne hrbtenice in se ukloni mnenju ki ga največkrat sliši. Zato pa je največja rana šolstva da ne uči kritičnega razmišljanja in razmišljanje z več zornih kotov hkrati .

_dice7 ::

Umetna inteligenca ni delovala po neinteligenčnemu principu? Naci!!!! Rasizem!!! KKKKKKK!!! Patriarhalne družba!!!! Kako si AI upa trditi da barva dildota ni najbolj pomembna stvar pod soncem!!!!

Looooooka ::

Glede na twitter replye so lahko chatbot makerji lepo tiho. Tam so glasni že par let ampak po 2 minutah se vidi, da jih večina zgolj indeksira stavke in povezave med njimi in potem odgovarjajo s takimi neumnostmi, da glava peče. Tam bi bila polovica twittov enakih, ker pač ne bi bilo dovolj stavkov. Ne glede na rasistične, seksistične odgovore jebilo tole res pbolj odobno neumnemu najstniku, kot pa prenapihnjenim obljubam ostalih chatbot programerjev.

Zgodovina sprememb…

- spremenilo: Looooooka ()

Stari maček ::

Očitno je bila punca preveč pametna, da se je navdušila nad Donaldom Trumpom, rasistično belo ideologijo (white supremacy), Hitlerjem itd

Jupito ::

dejansko se je naučila ogromno kompleksnih reči. Problem je v tem primeru izključno samo v bebavih ljudeh, ki so jo učili neumnosti. Dejansko bi bilo isto, če bi ti ljudje učili otroka...ta bi mislil da mu govorijo resnico, saj ne zna "kritično" razmišljati.

nekega otroka starega tam do morda 9 let bi brez težav naučili vse kar so twiteraši naučili Tay.

je izjavil:

Strokovnjaki za chatbote so si enotni v mnenju, da se je Microsoft projekta lotil slabo.

Se pravi, tako kot vseh ostalih projektov.

v bistvu ne. Projekta so se lotili odlično, bot se je v manj kot 24 urah naučil izjemne človeške govorice in povezav med stvarmi. Žal pa so jo uporabniki učili samo neumnosti.

Kako pa bi v 24 urah lahko dobro izvajal cenzuro pa nam povej ti.

Akhaja? Ta reč nima nobenga mehanizma, s katerim bi ah-hoc (kaj šele na podlagi učenja) določila, katero obnašanje je neprimerno in katere ideje niso najboljše? Edino pravilno, da so jo uničili! Glorificiran električni papagaj...

I used to be with it, but then they changed what it was.

Now what I'm with isn't it and what's it seems weird

and scary to me. It'll happen to you!

Now what I'm with isn't it and what's it seems weird

and scary to me. It'll happen to you!

nevone ::

Brez skrbi. Nikoli nisem nikomur preprečil, da je ostal neumen!

Si pa vseeno vesel, da so to drugi preprečili Tay.

o+ nevone

Either we will eat the Space or Space will eat us.

Bistri007 ::

> Odločili so se, da jo bodo poskusili navdušiti nad Donaldom Trumpom, rasistično belo ideologijo (white supremacy), Hitlerjem itd. Ne glede na nesprejemljivost njihovih idej...

In kaj je nesprejemljivega pri Donaldu Trumpu? Kakšne novice so to?

In kaj je nesprejemljivega pri Donaldu Trumpu? Kakšne novice so to?

Največja napaka desetletja je bila narejena 4. novembra 2008

Oni so goljufali in Alah je goljufal, Alah je najboljši prevarant. (Koran 3:54)

Citiraj svetega očeta Benedikta XVI. in postani "persona rudis"...

Oni so goljufali in Alah je goljufal, Alah je najboljši prevarant. (Koran 3:54)

Citiraj svetega očeta Benedikta XVI. in postani "persona rudis"...

Machete ::

To da je mental in v tekmi za kandidata.. A ni dovolj?

LC1000|Asrock-H470PG|i7-10700K|2x16GB|RTX-5080 GAMING|W10Pro

new Nintendo 2DS & 3DS XL|Galaxy S24+

new Nintendo 2DS & 3DS XL|Galaxy S24+

Bistri007 ::

Donald Trump samo govori o ograji. Naši so jo postavili skoraj čez noč. Kdo je tu bolj nesprejemljiv?

Največja napaka desetletja je bila narejena 4. novembra 2008

Oni so goljufali in Alah je goljufal, Alah je najboljši prevarant. (Koran 3:54)

Citiraj svetega očeta Benedikta XVI. in postani "persona rudis"...

Oni so goljufali in Alah je goljufal, Alah je najboljši prevarant. (Koran 3:54)

Citiraj svetega očeta Benedikta XVI. in postani "persona rudis"...

[D]emon ::

Edina razlika med Trumpom in norim starim descem ki na zelezniski postaji opleta s kurcem ter se dere bedarije so miljoni ki jih ima Trump na bancnem racunu. Clovek je izmecek.

Mavrik ta forum uporablja za daljsanje e-penisa. Ker si ne upa iz hise.

Markoff ::

rasistično belo ideologijo (white supremacy)

No comment there.

Antifašizem je danes poslednje pribežališče ničvredneža, je ideologija ničesar

in neizprosen boj proti neobstoječemu sovražniku - v zameno za državni denar

in neprofitno najemno stanovanje v središču Ljubljane. -- Tomaž Štih, 2021

in neizprosen boj proti neobstoječemu sovražniku - v zameno za državni denar

in neprofitno najemno stanovanje v središču Ljubljane. -- Tomaž Štih, 2021

invisuu ::

Bistri007 ::

Edina razlika med Trumpom in norim starim descem ki na zelezniski postaji opleta s kurcem ter se dere bedarije so miljoni ki jih ima Trump na bancnem racunu. Clovek je izmecek.

A Clintonovka pa ni še večji izmeček? Ljudje jo imajo še manj radi od Trumpa...

Največja napaka desetletja je bila narejena 4. novembra 2008

Oni so goljufali in Alah je goljufal, Alah je najboljši prevarant. (Koran 3:54)

Citiraj svetega očeta Benedikta XVI. in postani "persona rudis"...

Oni so goljufali in Alah je goljufal, Alah je najboljši prevarant. (Koran 3:54)

Citiraj svetega očeta Benedikta XVI. in postani "persona rudis"...

[D]emon ::

Hillary je budala ze po defaultu. Pri takem mozu pa vseh drogah, ki jih je skadila v svojih hipijevskih letih, bi tezko bila kaj drugega.

O Trumpu ti pa pove vse ze dejstvo, da je najpametnejsemu v Bush druzini ime Jeb in niti on ne mara Trumpa.

O Trumpu ti pa pove vse ze dejstvo, da je najpametnejsemu v Bush druzini ime Jeb in niti on ne mara Trumpa.

Mavrik ta forum uporablja za daljsanje e-penisa. Ker si ne upa iz hise.

Reycis ::

Tay ni storila ničesar narobe. Le človeštvu je postavila ogledalo. Ker veliki brat tega ne želi so jo sedaj spravili v šolo marksizma in politične korektnosti. Osebno bi raje videl, da še naprej govori resnico.

Bistri007 ::

Tay ni storila ničesar narobe. Le človeštvu je postavila ogledalo. Ker veliki brat tega ne želi so jo sedaj spravili v šolo marksizma in politične korektnosti. Osebno bi raje videl, da še naprej govori resnico.

Saj kitajska verzija chatbota deluje brez problema, ker je kitajski internet cenzuriran. In tudi uporabniki ne pišejo več bolj provokativnih sporočil, ker so brisana. Tako kot na S-T vsako omenjanje pedrov.

Največja napaka desetletja je bila narejena 4. novembra 2008

Oni so goljufali in Alah je goljufal, Alah je najboljši prevarant. (Koran 3:54)

Citiraj svetega očeta Benedikta XVI. in postani "persona rudis"...

Oni so goljufali in Alah je goljufal, Alah je najboljši prevarant. (Koran 3:54)

Citiraj svetega očeta Benedikta XVI. in postani "persona rudis"...

Reycis ::

Tay ni storila ničesar narobe. Le človeštvu je postavila ogledalo. Ker veliki brat tega ne želi so jo sedaj spravili v šolo marksizma in politične korektnosti. Osebno bi raje videl, da še naprej govori resnico.

Saj kitajska verzija chatbota deluje brez problema, ker je kitajski internet cenzuriran. In tudi uporabniki ne pišejo več bolj provokativnih sporočil, ker so brisana. Tako kot na S-T vsako omenjanje pedrov.

Slo-techu je sploh poseben primer. Se vidi, da ga moderirajo izbrani kadri FDV-ja. Bi se drznil trditi, da je bolj cenzuriran od Kitajcev. Portal je postal bolj politično korekten kot rtvslo in 24ur. Rezultat te levičarske regresije je tudi umik kvalitetnih komentatorjev in tudi bralcev. Včasih je bil tale portal med top 10 v Sloveniji.

Sicer pa brezveze pišem, ker bo itak tudi tole izbrisano vseeno pa naj se moderator poskuša doumeti neumnost trenutne politike.

Glugy ::

Lahk skor kerokol temo odprem pa najdem nasprotujoča si mnenja, je pa najosnovnejše moderiranje koristno v smislu osnov etike. Noben normalen portal ne more dopustit rasizma, sovražnega govora (kar pa ne vključuje nasprotujoči govor sam po sebi), spodbujanju sovraštva. Moderatorji težijo k temu da se obveljavi objektivno argumentiranje na eni in drugi strani in ne toliko izlivanje čustev vsevprek brez točno izraženega osnovanja/povoda za to. Recimo da rečeš da je vlada ku...(kletvica) to ne bo pomagal nobenmu. Če pa rečeš: glej koliko siromakov je zdajšnja vlada na novo proizvedla zarad tega ker vse več bremen nalaga šibkejšim delom družbe .. pa izrazš žalost ob tem je pa to nekaj razumnega. No al pa če si desničar rečeš: glej koliko investicij tujega kapitala je zdejšnja vlada zapravla s tem k ni znižala davka na dobiček, ukinla bolniških ipd. in ob tem izražaš žalost je to tud čist pošten komentar.

Večkrat dobim občutek da kdo pričakuje da bi se moral standardi moderiranja znižat. Samo se bojim da se bomo v takem primeru da to naredijo vsi portali degradiral kot družba.

Večkrat dobim občutek da kdo pričakuje da bi se moral standardi moderiranja znižat. Samo se bojim da se bomo v takem primeru da to naredijo vsi portali degradiral kot družba.

Vredno ogleda ...

| Tema | Ogledi | Zadnje sporočilo | |

|---|---|---|---|

| Tema | Ogledi | Zadnje sporočilo | |

| » | Pogovarjajte se z Microsoftovo ZoOddelek: Novice / Ostala programska oprema | 8664 (6341) | nekikr |

| » | Microsoft pojasnjuje, kaj je šlo narobe s TayOddelek: Novice / Znanost in tehnologija | 15389 (11319) | Glugy |

| » | Učeči robot Tay v 16 urah od mladenke do vulgarnega nacista (strani: 1 2 )Oddelek: Novice / Znanost in tehnologija | 27903 (22838) |